금융권 AI 도입에 필요한 보안정책 가이드라인 나온다…금보원 "연내 공개"

- 가

- 가

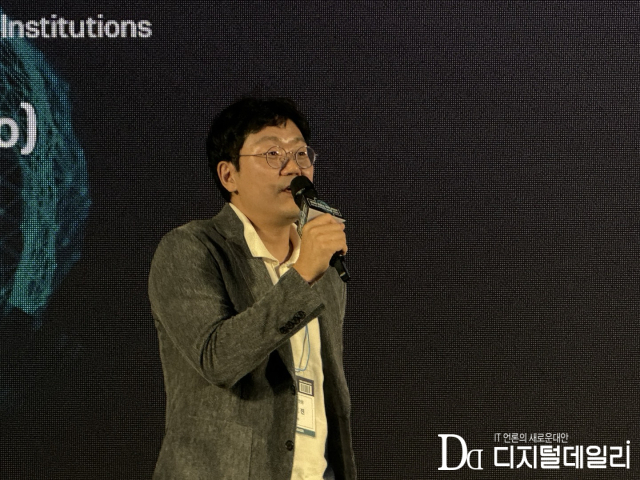

서호진 금융보안원 금융혁신팀 수석팀장이 28일 서울 중구 동대문디자인플라자(DDP)에서 열린 '코리아핀테크위크 2024' 무대에 올라 '금융권 인공지능(AI) 거버넌스 가이드'를 주제로 발표하고 있다.

[디지털데일리 김보민기자] 금융보안원(이하 금보원)이 연내 금융권에 특화된 인공지능(AI) 거버넌스 가이드라인을 공개한다. 해당 가이드라인은 금융당국의 망개선 로드맵에 따라 AI 도입을 검토하고 있는 기업에게 도움이 될 것으로 예상된다.

서호진 금보원 금융혁신팀 수석팀장은 지난 28일 서울 중구 동대문디자인플라자(DDP)에서 열린 '코리아핀테크위크 2024' 무대에 올라 "금융분야 AI 거버넌스 가이드를 준비 중"이라며 "금융회사가 원하는 AI 개발 활용 목표를 달성하도록 돕는 것이 핵심"이라고 밝혔다.

앞서 금융위원회(이하 금융위)는 샌드박스를 통해 인터넷 활용 제한에 대한 규제 특례를 허용하는 내용을 담은 망분리 개선 로드맵을 공개했다. 여기에는 생성형 AI 사용을 허용하는 내용이 담겼는데, 전제 조건으로 보안 대책을 마련해야 한다는 전제 조건이 포함됐다.

금보원이 준비하고 있는 AI 거버넌스 가이드는 적절한 보안 대책을 세우는 데 어려움을 겪는 금융회사에 도움이 될 것으로 보인다. 해당 가이드라인은 연내 공개될 예정인데, 늦어도 10월 중 윤곽이 나올 전망이다.

서 팀장은 "거버넌스 구축의 기본 원칙은 ▲기존 모델 및 시스템 활용 ▲기존 법령 및 제도 준수 ▲AI 기본 원칙 마련 등 세 가지로 나뉜다"며 "기존 체계를 활용하되 AI 특수 위험을 관리하는 방안을 마련하는 내용"이라고 설명했다. 이어 "AI 기술을 기반으로 금융 서비스를 운영한다 하더라도, 기존 법령이나 제도에 면제되는 것이 아니다"라며 "기존 법을 준수하고, 안전하고 신뢰할 수 있고 동시에 책임 있는 AI 개발 활용을 위해 내부 기본 원칙을 마련해야 한다는 내용이 담길 예정"이라고 덧붙였다.

이날 서 팀장은 가이드에 담길 거시적인 내용을 소개했다. 금융회사는 자사 환경에 맞는 순환식 위험관리 체계를 구축하고, AI 조직을 구성하는 방식으로 보안 대책을 세울 수 있다. AI 통합 관리뿐만 아니라 법무 및 컴플라이언스 조직을 마련해 책임과 운영 관리를 명확히 하는 것이 핵심이다.

전사적 커뮤니케이션 채널과 컨트롤타워를 구축하고, 금융 소비자 보호, 사내 문화조성 등도 가이드에 포함될 것으로 보인다. 서 팀장은 "해당 내용을 기반으로 거버넌스 가이드의 상세 내용을 배포하겠다"고 말했다.

가이드에는 AI를 관리할 '인간'의 역할에 대한 내용도 담길 것으로 보인다. 서 팀장은 "AI 자체가 100% 완벽할 수 없고 편견, 오류, 불확실성이 있기 때문에 인간의 역할은 반드시 필요하다"며 "해외에서 말하는 '휴먼 인 더 루프(Human-in-the-Loop·인간 상호작용이 필요한 모델)'라는 개념처럼, 금융분야는 개인 재산을 다루는 만큼 인간의 역할이 중요할 것"이라고 부연했다.

이주현 금융보안원 AI기술팀 책임이 28일 서울 중구 동대문디자인플라자(DDP)에서 열린 '코리아핀테크위크 2024' 무대에 올라 '금융권 생성형 인공지능(AI) 도입에 따른 위협과 과제'를 주제로 발표하고 있다.

한편 금보원은 이날 세션 발표에서 금융권이 AI 기술을 도입하는 과정에서 참고할 만한 위협 사례를 소개하는 시간을 가졌다.

이주현 금보원 AI기술팀 책임은 "금융권의 경우 고객 상담, 정보기술(IT) 개발, 사기 탐지, 금융투자 분석, 마케팅, 보고서 초안 작성, 신용 및 대출 평가, 계약서 분석 등 다양한 영역에서 생성형 AI를 활용할 수 있다"면서도 "여전히 위험 요인(리스크)도 존재한다"고 강조했다.

잘못된 정보를 주는 환각 현상(할루시네이션)은 물론, 공정성과 투명성 측면에서도 위협 요인이 존재한다는 것이다. 허깅페이스 등 온라인 상에 올라온 모델을 그대로 가져다 쓰는 경우도 많은데, 이때 사용자 단위에서 악성코드에 감염되는 우려도 배제할 수 없다.

AI 사고나 윤리에 대한 책임도 따져볼 부분이다. 이 책임은 "이미지를 만들어주는 AI 모델에는 저작권 필터가 있지만 이를 우회하는 경우가 있다"며 "책임성 문제가 존재한다는 의미인데, 사고가 발생했을 때 사용자, 기업, 정부 중 어떤 쪽이 책임을 져야 할지에 대한 부분이 아직까지 모호한 상황"이라고 말했다.

이에 금보원은 금융기관이 '안전'에 초점을 둔 AI 시스템을 구축할 수 있도록 전문 프레임워크를 구축할 방침이다. 금융기관이 프레임워크를 기반으로 AI 모델과 서비스에 대한 안전성을 검증할 수 있도록 돕는다는 구상이다.

현재 주요국과 글로벌 기업들 사이에서는 AI에 특화된 안전 및 보안 프레임워크를 구축하는 것이 '선택이 아닌 필수'로 여겨지고 있다. 미국의 경우 지난해 AI 위험관리 프레임워크를 공개했고, 싱가포르는 모델 검증이 가능한 AI 베리파이(Verify)'를 마련했다.

프레임워크 이름은 'AI 세이프티(Safety)'로, 이르면 내년 중 공식화될 전망이다. AI 세이프티 프레임워크는 보안성, 신뢰성, 안전성, 윤리성, 공정성, 투명성, 책임성, 공정성 등 7가지 가치를 중심으로 구성된다.

금보원은 프레임워크 일환으로 AI 워킹그룹을 운영해 금융권 의견을 수렴하고, 세부 검증기준을 마련할 계획이다. 금융회사 자체 점검으로 활용할 수 있는 자동 점검 도구도 개발한다.

당신이 좋아할 만한 뉴스

많이 본 기사

연재기사

실시간 추천 뉴스

-

AI로 가짜 쇼핑몰 뚝딱 만든다…"사기 수법 진화 중"

2025-04-16 20:00:00 -

최민희 의원, 부총리급 '과기정통인공지능부' 격상 개정안 발의

2025-04-16 18:17:07 -

뉴진스, 데뷔 1000일 자축했지만…법원 판단은 그대로

2025-04-16 18:11:42 -

스타링크 韓 진출 임박…정부, 전파 혼간섭 방지 '총력'

2025-04-16 17:54:18 -

[DD퇴근길] KT, 미디어사업 전략 수정…"공격적으로 AI 접목"

2025-04-16 16:53:56