[2024 IT혁신상품] AI메모리 가교 역할…SK하이닉스 16단 HBM3E

- 가

- 가

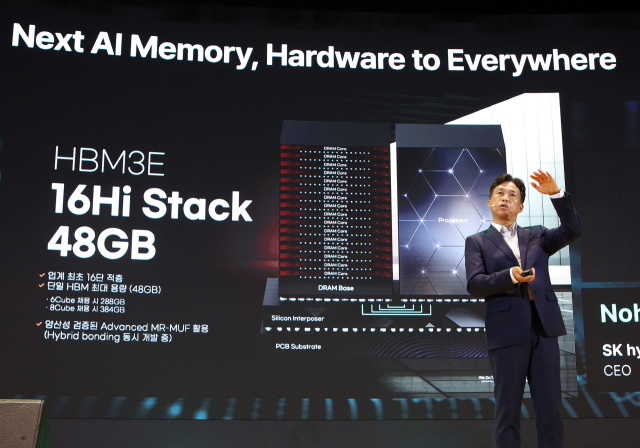

11월 4일 'SK AI 서밋'에서 16단 HBM3E를 공개한 곽노정 SK하이닉스 대표 [ⓒSK하이닉스]

[디지털데일리 고성현 기자] 생성형AI 구현의 핵심인 반도체 칩 발전이 지속되면서 이 산업을 지탱하는 고대역폭메모리(HBM)의 발전 속도 역시 빨라지고 있다. 특히 차세대 HBM에 혁신을 가져올 하이브리드 본딩 공법 적용이 상용화의 어려움을 겪으면서, 가교 역할을 할 제품과 공법에 대한 중요성도 어느때보다 커진 상황이다.

AI용 메모리인 HBM의 핵심은 대역폭과 용량의 확대다. 데이터가 이동하는 길인 대역폭을 늘려야만 기하급수적으로 늘어가는 데이터 양을 빠르게 읽거나 쓸 수 있으며 높은 용량을 통해 방대해진 AI모델을 감당할 수 있게 된다. 용량·대역폭을 확대하기 위해서는 개별 D램 칩(Die)의 공정 개선은 물론, D램 단수를 쌓는 작업이 병행돼야 한다.

SK하이닉스가 공개한 '16단 HBM3E'는 5세대 HBM(HBM3E) 신규 제품으로 D램 코어 다이 8단, 12단 적층 대비 성능을 높인 것이다. 기존 HBM3E의 설계를 유지하되 더 많은 단수를 쌓아 데이터 처리를 위한 읽기·쓰기 성능, 용량을 높였다. 내부 분석 결과 12단 대비 학습 분야에서 18%, 추론 분야에서 32% 성능이 향상됐다.

SK하이닉스는 올해 2월 열린 전세계적인 반도체 학술 행사 국제고체회로공학회(ISSCC 2024)에서 16단 HBM3E 제품을 공개한 바 있다. 16단 HBM3E에는 기존에 SK하이닉스가 주력으로 활용해 온 어드밴스드 매스리플로우-몰디드언더필(MR-MUF) 공법이 적용될 예정이다.

16단 HBM3E가 상용화될 시기로는 내년 상반기가 꼽히고 있다. HBM 칩의 큰 손인 엔비디아가 주요 고객사로, 내년 본격화될 아키텍처 '블랙웰'에 탑재될 것으로 전망된다. 현재 SK하이닉스는 내년 초 엔비디아 등에 48GB 16단 HBM3E 샘플을 공급할 예정이다.

곽노정 SK하이닉스 대표는 11월 4일 'SK AI 서밋'에서 "(HBM3E 16단 제품으로) 고도화된 AI 연산과 대규모 데이터 처리를 요구하는 최신 시스템에서 더욱 효율적인 성능을 제공할 수 있을 것으로 기대된다"고 말했다.

당신이 좋아할 만한 뉴스

많이 본 기사

연재기사

실시간 추천 뉴스

-

최수연 네이버 대표 작년 연봉 19.7억⋯창업자 이해진 GIO 넘어

2025-03-18 19:00:47 -

SKT 유영상 연봉 뛰어넘은 강종렬 CSPO...임직원 수는 감소

2025-03-18 17:26:31 -

[DD퇴근길] "저력 잃었다"…'독한 삼성' 강조한 이재용, 주총서 보여줄까

2025-03-18 17:07:08 -

마이데이터 전면 시행…이정렬 개보위 사무처장 "세계 최초 국민 자기정보결정권 완성"

2025-03-18 17:02:43 -

이진숙 방통위원장 "국회, 상임위원 추천하고 2인체제 지적해라"

2025-03-18 16:47:01