퀄컴-메타, 라마 2 기반 온디바이스 AI 애플리케이션 구현 ‘맞손’

- 가

- 가

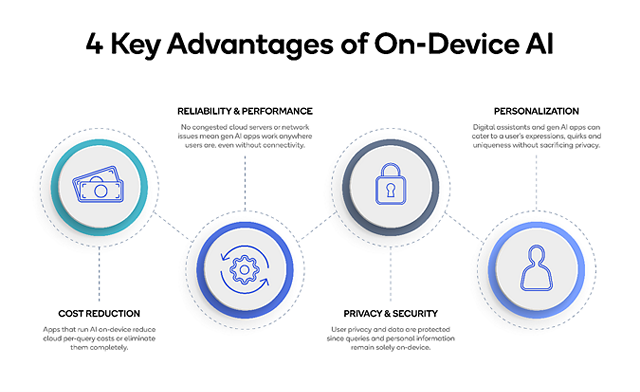

퀄컴 4 key advantages of On-deivce AI [ⓒ 퀄컴]

[디지털데일리 김문기 기자] 퀄컴은 메타의 라마 2 대형 언어 모델(LLM)을 클라우드에만 의존하지 않고 온디바이스에서 실행할 수 있도록 최적화할 예정이라고 19일 발표했다.

라마 2와 같은 생성형 AI 모델을 스마트폰, PC, VR/AR 헤드셋, 차량 등의 온디바이스에서 실행함으로써 개발자들은 클라우드 비용을 절감할 뿐만 아니라 이용자들에게 개인적이고 신뢰할 수 있고 맞춤화된 경험을 제공할 수 있다.

이에 퀄컴은 새롭고 흥미로운 AI 애플리케이션 제작이 가능한 라마 2 기반의 온디바이스 AI 구현이 가능하도록 지원할 예정이다. 이로써 고객과 파트너, 개발자들은 지능형 가상 비서 및 생산성 애플리케이션, 콘텐츠 제작 도구, 엔터테인먼트 등의 사용 사례를 구축할 수 있다. 스냅드래곤으로 구동되는 이러한 새로운 온디바이스 AI 경험은 인터넷 연결이 없는 곳에서나 비행기 모드에서도 사용이 가능하다.

두르가 말라디 퀄컴 테크날러지 수석 부사장 겸 기술, 기획 및 엣지 솔루션 부문 본부장은 "퀄컴은 메타의 개방적이고 책임 있는 AI 접근 방식에 힘입어 생성형 AI를 온디바이스에 적용해 모든 규모의 개발자들을 위한 혁신을 추진하고 진입 장벽을 완화하는 데 전념하고 있다"며 "생성형 AI의 효과적인 대중화를 위해서는 클라우드뿐만 아니라 스마트폰, 노트북, 차량, IoT 등과 같은 엣지 디바이스에서도 AI를 작동할 수 있어야 한다"고 말했다.

퀄컴은 오는 2024년부터 스냅드래곤 기반 단말기에 라마 2 기반 AI 구현이 가능하도록 지원할 예정이다. 개발자들은 퀄컴 AI 스택을 활용해 온디바이스 AI 애플리케이션을 최적화할 수 있다. 퀄컴 AI 스택은 스냅드래곤에서 AI를 더 효율적으로 처리하여 얇고 가벼운 소형 기기에서도 온디바이스 AI 구현을 가능하게 하는 전용 도구 모음이다.

당신이 좋아할 만한 뉴스

많이 본 기사

연재기사

실시간 추천 뉴스

-

행안부, 클라우드 네이티브 제도개선 착수…“공공SW 전반 변화해야”

2024-11-23 09:39:29 - 2024-11-22 20:49:20

-

주파수 재할당대가, 정부가 부르는게 값? “산정방식 검토 필요”

2024-11-22 18:23:52 - 2024-11-22 17:24:00

-

네이버페이, 한국재무관리학회 ‘상생금융 우수기업상’ 수상

2024-11-22 16:44:59